یکی از پدیدههایی که در سالهای اخیر با رونق هوش مصنوعی بهوجود آمده، دیپفیکها هستند. این واژه از ترکیب دو کلمهی «یادگیری عمیق» (deep learning) و «جعلی» (fake) تشکیل شده است.

«یادگیری عمیق» به روشهای یادگیری ماشینی اشاره دارد، در حالی که «جعلی» به معنای تقلبی، تقلیدی یا فریبدهنده است. بنابراین، دیپفیک نوعی جعل است که با کمک فرآیندهای هوش مصنوعی ایجاد میشود.

این جعلها میتوانند شامل تصاویر کامپیوتری ساختگی از افراد مشهور، عکسها یا ویدیوهایی باشند که در آنها چهرهها با چهرهی دیگری جایگزین شدهاند، یا حتی فایلهای صوتی و پیامهایی که در آنها صدای شناختهشدهای عباراتی را بیان میکند که در واقع هرگز نگفته است.

چنین جعلهایی در زمینهی تصویر، ویدیو و صدا همواره وجود داشتهاند. اما اکنون به لطف فناوری هوش مصنوعی، این جعلها تقریباً بینقص و تشخیص آنها از نسخههای واقعی بسیار دشوار شده است.

علاوه بر این، نرمافزارهای مورد نیاز برای ساخت دیپفیک در دسترس عموم هستند و اغلب حتی به صورت سرویسهای آنلاین نیز ارائه میشوند؛ به این معنا که امروزه هر کسی میتواند دیپفیک بسازد.

پتانسیل بالا برای سوءاستفاده

برنامههای هوش مصنوعی برای ساخت دیپفیکها اغلب به عنوان نرمافزاری معرفی میشوند که میتوان از آنها برای شوخی با دیگران استفاده کرد.

اما در واقع، این برنامهها اغلب مورد سوءاستفادهی مجرمان قرار میگیرند. آنها از قابلیتهای هوش مصنوعی برای انجام کلاهبرداریها استفاده میکنند. برای مثال:

با استفاده از هوش مصنوعی، کلاهبرداری معروف «حقهی نوه» را بهبود میبخشند. آنها با استفاده از صدای ساختگی افراد خانواده با قربانی تماس میگیرند، شرایط اضطراری مانند تصادف را توضیح میدهند و درخواست کمک مالی فوری میکنند.

در ویدیویی، عبارتی را در دهان یک سیاستمدار میگذارند که او هرگز نگفته، و بدین وسیله تلاش میکنند تا بر افکار عمومی تأثیر بگذارند.

از صدای یک فرد مشهور برای تبلیغ محصولی بدون اطلاع یا رضایت او استفاده میکنند. مشتریانی که این محصول را سفارش میدهند، یا با قیمتی بالا فریب میخورند یا هرگز محصولی دریافت نمیکنند.

تشخیص تصاویر دیپفیک

در آغاز ظهور کلاهبرداریهای دیپفیک، مصرفکنندگان تنها با دقت بالا در نگاه و شنیدن میتوانستند خود را از فریب مجرمان حفظ کنند. دلیل آن این بود که عملکرد هوش مصنوعی اغلب نادقیق بود و بسیاری از جزئیات بهدرستی یا واقعگرایانه نمایش داده نمیشدند.

با این حال، بهزودی برنامههای دیگری مبتنی بر هوش مصنوعی در اینترنت ظاهر شدند که تصاویر و ویدیوها را بهطور دقیق برای یافتن این خطاها بررسی میکردند و الگوهای رنگ و بافتها را نیز در تحلیل خود در نظر میگرفتند. اکنون مجموعهای از چنین برنامههایی در دسترس قرار دارد. بسیاری از آنها بهصورت رایگان قابل استفاده هستند.

کاربر، تصویر یا ویدیویی را در یک وبسایت آپلود میکند و هوش مصنوعی آن را تحلیل کرده و به کاربر اعلام میکند که آیا دیپفیک است یا نه.

با این حال، در آزمایشها عملکرد این ابزارها قانعکننده نبود و نتایج رضایتبخشی ارائه ندادند.

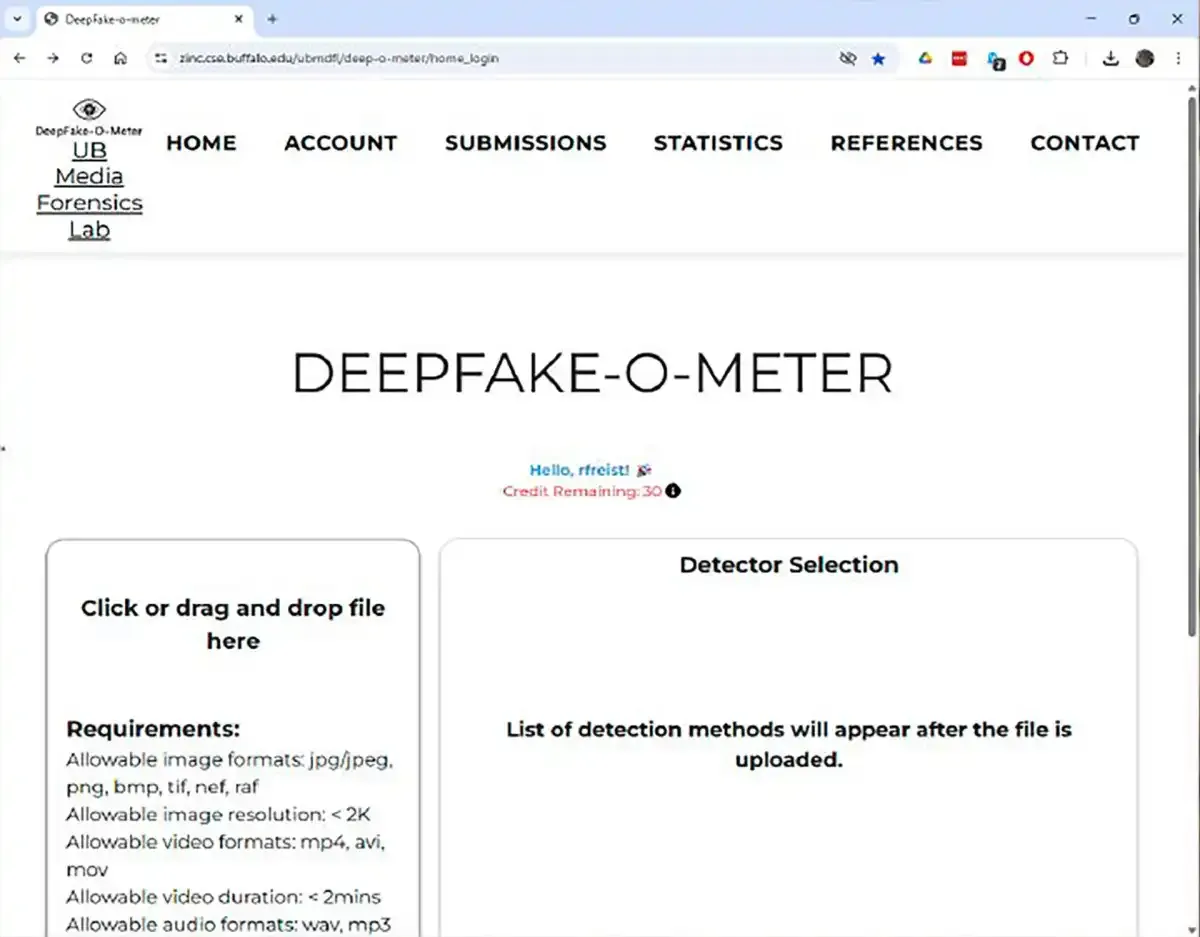

احتمالاً جامعترین ابزار شناسایی دیپفیک در اینترنت توسط دانشگاه بوفالو در ایالت نیویورک آمریکا ارائه شده است. پروژهای به نام Deepfake-o-Meter که توسط تیمی در آزمایشگاه پزشکی قانونی رسانه (Media Forensic Laboratory) توسعه یافته، ۱۶ برنامهی شناسایی هوش مصنوعی از جامعهی متنباز را گرد هم آورده و آنها را با تصاویر، ویدیوها و فایلهای صوتی که کاربران آپلود میکنند، تغذیه میکند.

پس از چند ثانیه، این ابزارها نتایج خود را نمایش میدهند و احتمال دیپفیک بودن رسانهی آپلودشده را اعلام میکنند.

برای دسترسی به Deepfake-o-Meter تنها کافی است با آدرس ایمیل خود بهصورت رایگان ثبتنام کنید. پس از ثبتنام، کاربر ۳۰ اعتبار رایگان برای استفاده از سرویس دریافت میکند؛ هر درخواست بررسی یک اعتبار مصرف میکند.

در یک آزمایش کوچک، ما ابتدا یکی از معروفترین تصاویر دیپفیک دنیا، یعنی عکس پاپ فقید فرانسیس با کاپشن سفید پفی که با ابزار Midjourney ساخته شده را آپلود کردیم.

با این حال، تنها دو سرویس از میان ابزارهای Deepfake-o-Meter، احتمال بالای ۵۰ درصد برای جعلی بودن این تصویر ارائه دادند.

هیچیک از برنامههای شناسایی مورد استفاده در Deepfake-o-Meter نتوانستند تصویر پاپ فرانسیس با کاپشن سفید را بهطور قطعی بهعنوان دیپفیک تشخیص دهند.

سایر تصاویر تولیدشده با هوش مصنوعی نیز بهطور قابلاطمینانی شناسایی نشدند.

در یک آزمایش دوم، ما با استفاده از ابزار تولید پرترهی Canva.com تصویری از یک زن ایجاد کردیم. این بار، هفت ابزار از میان شانزده ابزار هوش مصنوعی توانستند این تصویر را به عنوان یک دیپفیک تشخیص دهند.

ابزار شناسایی هوش مصنوعی شرکت فرانسوی Sightengine عملکردی بسیار سریعتر از ابزارهای Deepfake-o-Meter دارد. در این آزمایش، این برنامه بلافاصله پس از آپلود تصویر، آن را شناسایی کرد.

برای پرترهی زنی که با Canva ساخته شده بود، Sightengine احتمال ۹۹ درصدی برای تولید شدن تصویر توسط هوش مصنوعی اعلام کرد. با این حال، این برنامه نیز در مواجهه با تصویر پاپ فرانسیس نتوانست نتیجهی قطعی ارائه دهد—بر اساس اعلام Sightengine، احتمال دیپفیک بودن آن عکس ۵۳ درصد بود.

شناسایی تصاویر دیپفیک از طریق این جزئیات

ابزارهای شناسایی دیپفیک مانند Sightengine ابزارهای مهمی برای تشخیص تصاویر جعلی هستند. اما در بسیاری از موارد، حتی با چشم غیرمسلح هم میتوان متوجه شد که یک تصویر واقعی نیست—چرا که شیطان در جزئیات پنهان است.

یکی از بزرگترین چالشهای هوش مصنوعی، بازنمایی انگشتهای انسان است. برنامهها در حین آموزش، میلیونها تصویر را بررسی میکنند که بسیاری از آنها شامل دست و انگشت هستند.

اما در این تصاویر، اغلب دستها ناقص هستند. برای مثال، در یک عکس دستدادن، معمولاً تنها سه انگشت دیده میشود. در سایر تصاویر، برخی انگشتان در جیب هستند یا با اشیایی بهصورت کامل یا جزئی پوشانده شدهاند.

از آنجا که هوش مصنوعی نمیداند انسان چند انگشت دارد، از این دادهها چنین برداشت میکند که تعداد و طول انگشتها میتواند متغیر باشد. بنابراین، دستهایی با تعداد انگشت بیشتر یا کمتر تولید میکند یا انگشتهایی با اندازهها و طولهای ناهماهنگ به تصویر اضافه میکند.

دیگر مشکلات رایج در تولید تصاویر دیپفیک عبارتند از:

بازوها و پاها در موقعیت نادرست قرار دارند یا نمیتوان آنها را به بدن فرد نسبت داد.

موها ظاهر مصنوعی دارند؛ رشتههای مو در زاویههای نادرست میافتند یا به فرد مشخصی تعلق ندارند.

در جزئیات لباس نیز مشکل دیده میشود: دکمههای متفاوت روی یک پیراهن یا پالتو، گردنبندهایی که حلقهی بستهای تشکیل نمیدهند یا قاب عینکهایی که دچار تغییر شکل شدهاند.

نوشتهها بهصورت کاراکترهای کشیده و ناخوانا ظاهر میشوند.

سایههای غیرواقعی در پسزمینه، یا ناهماهنگی در تناسب اجزا نیز از نشانههای دیگر هستند.

شناسایی ویدیوهای دیپفیک با نرمافزارهای هوش مصنوعی

تولید ویدیوهای دیپفیک در سال گذشته با معرفی مولد ویدیوی Sora از OpenAI جهشی چشمگیر داشت. این ویدیوها آنقدر واقعی به نظر میرسند که تقریباً قابل تشخیص از ویدیوهای واقعی نیستند.

در حال حاضر، میتوان در یوتیوب تعداد زیادی ویدیوی ساختهشده با این فناوری جدید پیدا کرد که ظاهری شگفتانگیز و واقعی دارند.

در زمینهی شناسایی دیپفیک ویدیوها، ابزارهای هوش مصنوعی رایگانی در دسترس هستند؛ از جمله:

هر دو بهصورت برنامههای تحت وب (web application) طراحی شدهاند.

Deepware.ai کاملاً رایگان است.

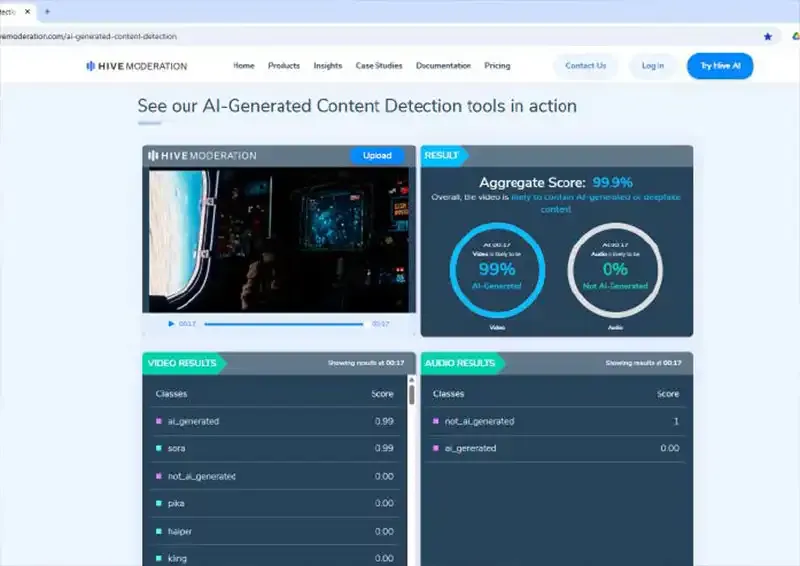

نسخهی پایهی ابزار Hive فقط ویدیوهایی با حداکثر طول ۲۰ ثانیه را میپذیرد.

ما چند ویدیوی ساختهشده با Sora را در هر دو وبسایت آپلود کردیم تا ببینیم عملکرد آنها چگونه است.

نتیجه در Deepware ناامیدکننده بود: این برنامه در هیچیک از نمونههای ما نتوانست دیپفیکها را تشخیص دهد.

در مقابل، عملکرد تشخیصدهندهی Hive کاملاً متفاوت بود: این ابزار برای تمام ویدیوهای ساختهشده با Sora، احتمال دیپفیک بودن را ۹۹ درصد اعلام کرد.

شناسایی متون تولیدشده با هوش مصنوعی

در نگاه اول، تشخیص متونی که با چتباتهایی مانند ChatGPT یا Google Gemini تولید شدهاند، از متونی که توسط نویسندگان انسانی نوشته شدهاند، تقریباً غیرممکن است.

گرامر و املا در این متون معمولاً بینقص است و در متنهای داستانی بهندرت خطاهای واقعی دیده میشود.

با این حال، سبک نگارش آن را لو میدهد.

چتباتها تمایل دارند جملات را با ساختار و طولی یکدست و یکنواخت بنویسند. در حالی که نویسندگان انسانی سعی میکنند برای جلوگیری از ریتم یکنواخت و خستهکنندهی خواندن، در متن خود تنوع و تغییر ایجاد کنند.

علاوه بر این، متون تولیدشده با هوش مصنوعی معمولاً مثالهایی برای حقایق ذکرشده ارائه نمیدهند، جزئیات مشخص ندارند و فاقد ظرافتهای معنایی و ملاحظات انسانی هستند.

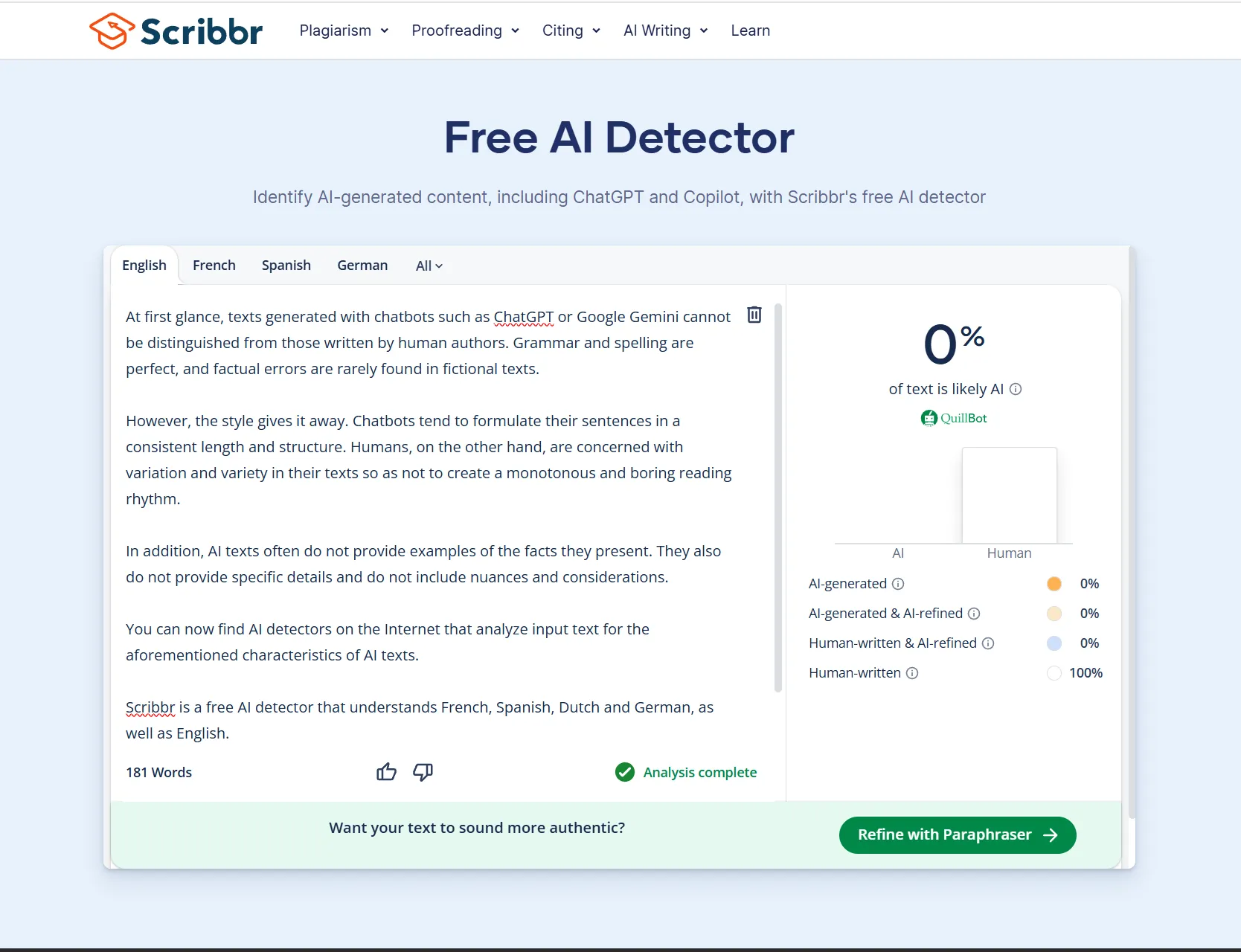

در حال حاضر ابزارهایی در اینترنت وجود دارند که متن ورودی را از نظر همین ویژگیهای خاص تحلیل کرده و تشخیص میدهند که آیا توسط هوش مصنوعی نوشته شده است یا خیر.

از جمله این ابزارها:

Scribbr

یک ابزار رایگان تشخیص هوش مصنوعی است که از زبانهای انگلیسی، فرانسوی، اسپانیایی، هلندی و آلمانی پشتیبانی میکند.Isgen.ai

از چند ده زبان دیگر نیز پشتیبانی میکند، اما تنها نسخهی پایهی آن رایگان است.

در طرح freemium این سرویس، پس از ثبتنام، میتوانید تا ۱۲٬۰۰۰ واژه در ماه را در حداکثر ۵۰ بار استفاده تحلیل کنید.

شناسایی ویدیوهای دیپفیک از طریق جزئیات ظریف

ویدیوهای دیپفیک اغلب همان خطاهایی را دارند که در تصاویر تولیدشده با هوش مصنوعی مشاهده میشود: متون ناخوانا هستند، جزئیات غیرمنطقی یا در دنیای واقعی غیرممکن هستند.

بهعنوان مثال، سایهها معمولاً اشتباهاند و موها ارتباط طبیعی با سر ندارند.

طراحی پسزمینه نیز با سایر بخشهای فیلم همخوانی ندارد. همچنین، در بسیاری از موارد رزولوشن افراد حاضر در ویدیو بالاتر از محیط اطرافشان است که غیرطبیعی به نظر میرسد.

علاوه بر این، برخی جزئیات خاص فقط در تصاویر متحرک (ویدیو) دیده میشوند. برای مثال:

افراد در ویدیوها اغلب بهطور غیرطبیعی آرام حرکت میکنند و گویی در حالتی شبیه به خلسه هستند.

چهرهی آنها بیاحساس و بدون هیچ حالت چهرهای است و پلک نمیزنند.

برای تشخیص این نکات، گاهی لازم است سرعت پخش ویدیو را کاهش دهید.

شناسایی صدای دیپفیک با ابزارها و نشانهها

با نرمافزارهایی مانند Real Time Voice Cloning اکنون میتوان فقط با چند ثانیه ضبط صوتی، صدایی جعلی از یک فرد ساخت که میتواند هر متنی را با صدای او بخواند.

با این حال، این فناوری هنوز بینقص نیست. در مطالعات مختلف، افراد شرکتکننده توانستند در دو سوم موارد، صدای مصنوعی را از صدای واقعی تشخیص دهند.

با این وجود، کیفیت صدا آنقدر بالا رفته که مجرمان با استفاده از تماسهای اضطراری جعلی توانستهاند افراد را فریب دهند.

در حال حاضر، بیشتر محصولاتی که برای شناسایی صدای جعلی ارائه میشوند، از کشورهای انگلیسیزبان هستند.

برای مثال:

شرکت امنیتی McAfee ابزاری به نام Deepfake Detector معرفی کرده که صداهای مصنوعی در ویدیوها و فایلهای صوتی را شناسایی میکند.

این ابزار روی تمامی کامپیوترهای دارای پردازندههای Intel Core Ultra 200V قابل استفاده است.شرکتهایی مانند Resemble.ai و AI Voice Detector نیز نرمافزارهایی ویژه برای شرکتها توسعه دادهاند.

ابزار دیگری به نام Hiya AI Voice Detector نیز وجود دارد که در حال حاضر رایگان است.

این ابزار بهصورت افزونه مرورگر کروم طراحی شده و صدای موجود در وبسایتها را تحلیل میکند.

در تست انجامشده، این ابزار عملکردی فراتر از انتظار داشت.

در نهایت، با پیشرفت روزافزون فناوری هوش مصنوعی و ظهور ابزارهای قدرتمندی مانند دیپفیکها، تشخیص محتوای جعلی به چالشی جدی تبدیل شده است. هرچند این فناوریها میتوانند به شکل فریبندهای واقعی به نظر برسند، اما با شناخت دقیق جزئیات و استفاده از ابزارهای شناسایی هوش مصنوعی، هنوز امکان تشخیص دیپفیکها وجود دارد. آگاهی و هوشیاری کاربران در کنار بهرهگیری از این تکنولوژیها کلید مقابله با سوءاستفادهها و حفظ اعتماد در دنیای دیجیتال است.